Tuần này tại Google Cloud Next ở Las Vegas, Google liên tiếp công bố hàng loạt cập nhật về hạ tầng và hệ sinh thái AI. Song song đó, Meta gây chú ý với một quyết định khá bất ngờ trong cách thu thập dữ liệu để huấn luyện AI agent — một tiết lộ hiếm hoi về những gì thực sự đang diễn ra bên trong các lab lớn. Và Thinking Machines Lab, startup AI mới 15 tháng tuổi do cựu CTO OpenAI sáng lập, vừa đặt dấu mốc với thỏa thuận hàng tỷ đô cùng Google Cloud.

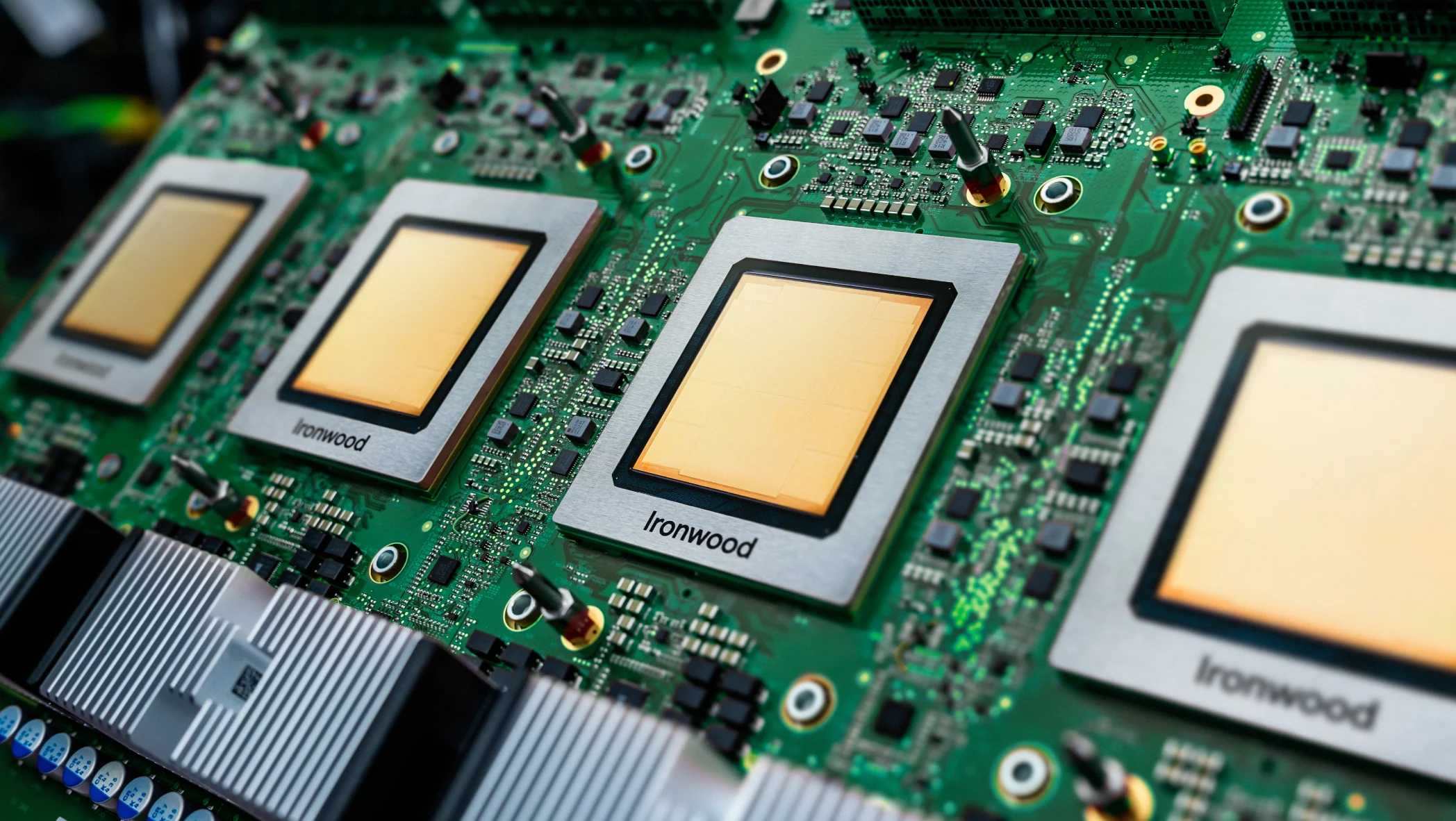

1. Google ra mắt TPU thế hệ 8: Mạnh hơn 2,8 lần — giá không đổi

Tại Google Cloud Next, Google giới thiệu thế hệ TPU (Tensor Processing Unit) thứ 8 với điểm mới đáng chú ý: lần đầu tiên được chia thành hai dòng chip riêng biệt — TPU 8t chuyên cho huấn luyện mô hình, và TPU 8i chuyên cho inference. TPU 8t cho hiệu suất cao hơn 2,8 lần so với thế hệ Ironwood trước đó trong khi giữ nguyên mức giá. TPU 8i cải thiện tốc độ inference 80% so với thế hệ cũ. Cả hai dòng dự kiến ra mắt trên Google Cloud trong năm 2026.

Bước đi này nằm trong chiến lược dài hạn của Google nhằm bớt phụ thuộc vào Nvidia — trong khi vẫn duy trì hợp tác với Nvidia để tối ưu networking cho cụm GB300 trên nền tảng cloud của mình. Cạnh tranh chip ngày càng gay gắt giữa Google, AMD và Nvidia đang kéo chi phí AI cloud đi xuống, và xu hướng này nhiều khả năng còn kéo dài.

Với các team đang tính toán bài toán chi phí triển khai AI — dù là gọi API hay vận hành model nội bộ — đây là tín hiệu đáng lưu ý: mức giá hiện tại không phải là điểm cuối. Những doanh nghiệp đầu tư vào AI từ bây giờ sẽ hưởng lợi kép: tận dụng chi phí thấp của giai đoạn hiện tại, đồng thời đón đầu xu hướng giảm giá sắp tới.

Nguồn: TechCrunch

Ghi chú thuật ngữ

- TPU (Tensor Processing Unit): Chip xử lý AI do Google tự phát triển, chuyên cho các phép tính trong deep learning

- inference: Quá trình mô hình AI xử lý đầu vào từ người dùng (phân biệt với training — giai đoạn huấn luyện ban đầu)

- Ironwood: tên mã thế hệ TPU 7 của Google, dùng làm mốc so sánh cho thế hệ mới

2. Meta ghi lại phím gõ và thao tác chuột của nhân viên để huấn luyện AI agent

Meta vừa triển khai Model Capability Initiative (MCI) — phần mềm được cài trực tiếp trên máy tính của nhân viên tại Mỹ, ghi lại thao tác chuột, phím gõ và chụp màn hình định kỳ trong giờ làm việc. Toàn bộ dữ liệu này được đưa vào pipeline huấn luyện AI agent của công ty.

Lý do Meta đưa ra khá thực tế: agent AI hiện nay vẫn vấp phải những thao tác mà con người làm gần như tự động — chọn mục trong dropdown menu, dùng phím tắt, chuyển qua lại giữa các ứng dụng. Phát ngôn viên Meta lý giải: “Nếu muốn xây dựng agent hỗ trợ người dùng làm việc trên máy tính, mô hình cần được học từ cách con người thực sự dùng máy.”

Đây là tiết lộ quan trọng về bài toán cốt lõi của AI agent: vấn đề không phải là thiếu “trí tuệ”, mà là thiếu dữ liệu hành vi thực tế. Viết nội dung, tóm tắt, phân tích — AI xử lý tốt. Nhưng điều hướng trong giao diện ERP, nhấp đúng mục trong dropdown — đó mới là điểm agent thường “đứng hình”. Cách giải quyết hiệu quả nhất: để mô hình học từ chính hành vi thực tế của người dùng.

Với các doanh nghiệp Việt Nam đang thử nghiệm hoặc triển khai AI agent: bài học rõ nhất là agent chuyên biệt sẽ vượt trội hơn agent dùng chung. Một agent được huấn luyện trên đúng quy trình làm việc của team bạn — dù chỉ từ dữ liệu nội bộ — sẽ hiệu quả hơn đáng kể so với model off-the-shelf. Đây là lợi thế cạnh tranh thực sự cho những đội ngũ bắt đầu đầu tư vào dữ liệu nội bộ từ sớm.

Nguồn: TechCrunch

Ghi chú thuật ngữ

- pipeline: Chuỗi quy trình xử lý dữ liệu từ thu thập đến huấn luyện mô hình

- Model Capability Initiative (MCI): tên chính thức của chương trình theo dõi nhân viên của Meta nhằm thu thập dữ liệu hành vi để huấn luyện agent

- off-the-shelf: Model có thể dùng ngay mà không cần tùy chỉnh, trái với model đã được fine-tune cho một domain cụ thể

3. Thinking Machines Lab: 15 tháng tuổi, hợp đồng tỷ đô với Google Cloud

Mira Murati, cựu CTO OpenAI, thành lập Thinking Machines Lab vào tháng 2/2025. Chỉ hơn một năm sau, startup này đã huy động 2 tỷ USD với mức định giá 12 tỷ USD ngay vòng seed, ra mắt sản phẩm đầu tiên — Tinker (tháng 10/2025): công cụ tự động hóa quy trình tạo frontier AI model tùy chỉnh cho doanh nghiệp. Và tuần này tại Cloud Next, công ty ký thỏa thuận hàng tỷ USD (single-digit billion) với Google Cloud, đổi lấy quyền truy cập hạ tầng GPU Nvidia GB300 mới nhất.

Google chọn hợp tác vì kiến trúc Tinker xây trên nền reinforcement learning — phương pháp huấn luyện đang tạo ra những bước đột phá lớn nhất tại các lab như DeepMind và OpenAI — và Google có khả năng hỗ trợ workload RL ở quy mô lớn.

Điều đáng chú ý không phải con số, mà là tốc độ. Chỉ 15 tháng từ khi thành lập đến khi ký hợp đồng tỷ đô với Google Cloud, với sản phẩm đã chạy thực tế. Đây là bằng chứng rõ ràng rằng frontier AI không còn là sân chơi riêng của OpenAI, Anthropic hay Google — hệ sinh thái đang rộng mở hơn cho các lab chuyên biệt, tinh gọn và có định hướng sản phẩm rõ ràng.

Với doanh nghiệp và startup Việt Nam đang lựa chọn nhà cung cấp AI: thị trường model frontier sẽ đa dạng hơn đáng kể trong 12–18 tháng tới. Tinker — được thiết kế riêng để xây custom frontier model cho enterprise — là cái tên đáng theo dõi nếu bạn đang tính đến bài toán có model riêng cho domain của mình.

Nguồn: TechCrunch

Ghi chú thuật ngữ

- reinforcement learning: Phương pháp huấn luyện AI dựa trên tín hiệu thưởng/phạt, hiện đang tạo ra những đột phá lớn nhất trong AI reasoning

- frontier AI model: Mô hình AI ở nhóm năng lực tiên tiến nhất hiện tại

- vòng seed: vòng gọi vốn đầu tiên của startup, thường ở giai đoạn rất sớm

- single-digit billion: Giá trị thỏa thuận nằm trong khoảng 1–9 tỷ USD